Mă simt înspăimântat. Foarte speriat.

Supravegherea și cenzura la nivel de internet, activate de puterea de calcul inimaginabil de vastă a inteligenței artificiale (AI), sunt aici.

Aceasta nu este o distopie futuristă. Se întâmplă acum.

Agențiile guvernamentale lucrează cu universități și organizații nonprofit pentru a folosi instrumente AI pentru a supraveghea și a cenzura conținutul de pe Internet.

Acest lucru nu este politic sau partizan. Nu este vorba despre o opinie sau idee anume.

Ceea ce se întâmplă este că un instrument suficient de puternic pentru a supraveghea tot ceea ce se spune și se face pe Internet (sau porțiuni mari din acesta) devine disponibil guvernului pentru a ne monitoriza pe toți, tot timpul. Și, pe baza acelei monitorizări, guvernul – și orice organizație sau companie cu care guvernul este partener – poate apoi să folosească același instrument pentru a suprima, a reduce la tăcere și a închide orice discurs nu îi place.

Dar asta nu este tot. Folosind același instrument, guvernul și partenerii săi public-privat, „neguvernamentali” (gândiți-vă, de exemplu: Organizația Mondială a Sănătății sau Monsanto) pot, de asemenea, să închidă orice activitate care este legată de internet. Operarea bancară, cumpărarea, vânzarea, predarea, învățarea, divertismentul, conectarea între ele – dacă inteligența artificială controlată de guvern nu vă place ceea ce spuneți dvs. (sau copiilor dvs.!) într-un tweet sau un e-mail, poate opri toate acestea pentru tu.

Da, am văzut asta la o scară foarte locală și politizată, de exemplu, camionierii canadieni.

Dar dacă am crede că acest tip de activitate nu s-ar putea, sau nu s-ar întâmpla, la scară națională (sau chiar mai înfricoșătoare – globală), trebuie să ne trezim chiar acum și să realizăm că se întâmplă și s-ar putea să nu fie oprită.

Noile documente arată IA finanțată de guvern destinată cenzurii online

Subcomisia selectată a Camerei SUA pentru armarea guvernului federal a fost înființată în ianuarie 2023 „pentru a investiga chestiunile legate de colectarea, analiza, diseminarea și utilizarea informațiilor despre cetățenii americani de către agențiile executive, inclusiv dacă astfel de eforturi sunt ilegale, neconstituționale sau neetice în alt mod”.

Din păcate, activitatea comitetului este văzută, chiar și de către membrii săi, ca fiind în mare măsură politică: parlamentarii conservatori investighează ceea ce percep ei a fi reducerea la tăcere a vocilor conservatoare de către agențiile guvernamentale de înclinație liberală.

Cu toate acestea, în investigațiile sale, acest comitet a scos la iveală câteva documente uluitoare legate de încercările guvernamentale de a cenzura discursul cetățenilor americani.

Aceste documente au implicații cruciale și terifiante pentru întreaga societate.

În raportul intermediar al subcomisiei, din 5 februarie 2024, documentele arată că grupurile academice și nonprofit propun unei agenții guvernamentale un plan de a folosi „servicii de dezinformare” AI pentru a cenzura conținutul de pe platformele de internet.

Mai exact, Universitatea din Michigan explică Fundației Naționale pentru Știință (NSF) că instrumentele bazate pe inteligență artificială finanțate de NSF pot fi folosite pentru a ajuta platformele de social media să efectueze activități de cenzură fără a fi nevoie să ia efectiv decizii cu privire la ceea ce ar trebui cenzurat.

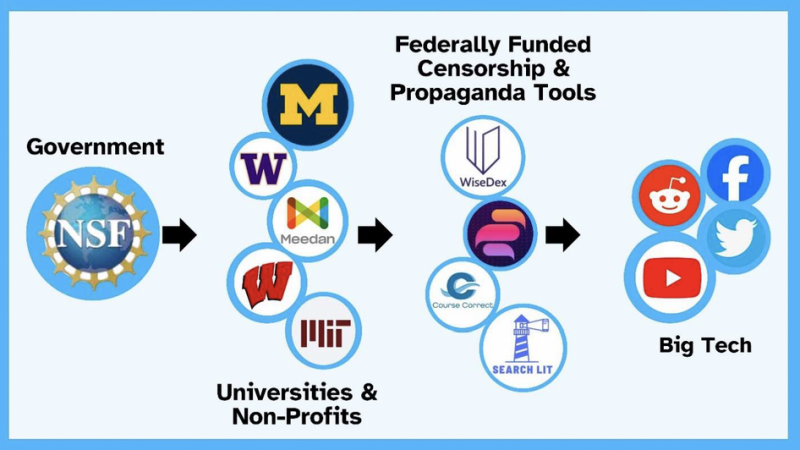

Iată cum este vizualizată relația în raportul Subcomitetului:

Iată un citat specific prezentat în raportul subcomisiei. Acesta provine din „notele vorbitorilor de la prima prezentare a Universității din Michigan către Fundația Națională pentru Știință (NSF) despre instrumentul său WiseDex, finanțat de NSF și alimentat de AI.” Notele sunt în dosarul comisiei.

Serviciul nostru de dezinformare îi ajută pe factorii de decizie de la platformele care doresc să... împingă responsabilitatea pentru judecăți dificile către cineva din afara companiei... prin exteriorizarea responsabilității dificile a cenzurii.

Aceasta este o declarație extraordinară pe atât de multe planuri:

- Echivalează în mod explicit „serviciul de dezinformare” cu cenzura.

Aceasta este o ecuație crucială, deoarece guvernele din întreaga lume pretind că combat dezinformarea dăunătoare când, de fapt, sunt adoptând proiecte de lege masive de cenzură. a declarat WEF „dezinformarea și dezinformarea” „cele mai grave riscuri globale” în următorii doi ani, ceea ce înseamnă că cele mai mari eforturi ale lor se vor îndrepta către cenzură.

Când un contractant guvernamental declară în mod explicit că vinde un „serviciu de dezinformare” care ajută platformele online să „exteriorizeze cenzura” – cei doi termeni sunt recunoscuți ca fiind interschimbabili.

- Se referă la cenzură ca la o „responsabilitate”.

Cu alte cuvinte, presupune că o parte din ceea ce ar trebui să facă platformele este cenzură. Nu protejați copiii de prădătorii sexuali sau cetățenii inocenți de dezinformare - doar cenzură simplă și nealterată.

- Se afirmă că rolul AI este de a „externaliza” responsabilitatea pentru cenzură.

Platformele Tech nu vor să ia decizii de cenzură. Guvernul vrea să ia aceste decizii, dar nu vrea să fie văzut ca cenzură. Instrumentele AI permit platformelor să „exteriorizeze” deciziile de cenzură și guvernului să-și ascundă activitățile de cenzură.

Toate acestea ar trebui să pună capăt iluziei că ceea ce guvernele din întreaga lume numesc „combaterea dezinformării și a discursului instigator la ură” nu este o cenzură directă.

Ce se întâmplă când cenzura AI este implementată pe deplin?

Știind că guvernul plătește deja pentru instrumentele de cenzură AI, trebuie să ne gândim la ceea ce presupune acest lucru.

Fără limite de forță de muncă: După cum subliniază raportul Subcomitetului, limitele cenzurii online guvernamentale au implicat, până acum, un număr mare de oameni necesari pentru a parcurge fișiere nesfârșite și a lua decizii de cenzură. Cu inteligența artificială, abia dacă oamenii trebuie să fie implicați, iar cantitatea de date care poate fi supravegheată poate fi la fel de vastă ca tot ceea ce spune cineva pe o anumită platformă. Acea cantitate de date este de neînțeles pentru un creier uman individual.

Nimeni nu este responsabil: Unul dintre cele mai înfricoșătoare aspecte ale cenzurii AI este că, atunci când AI o face, nu există nicio ființă umană sau organizație – fie că este vorba despre guvern, platforme sau universitate/nonprofit – care este de fapt responsabilă pentru cenzură. Inițial, oamenii furnizează instrucțiunilor instrumentului AI pentru ce categorii sau tipuri de limbaj să cenzureze, dar apoi mașina merge mai departe și ia singur deciziile de la caz la caz.

Fără recurs pentru nemulțumiri: Odată ce AI este dezlănțuită cu un set de instrucțiuni de cenzură, va mătura miliarde de puncte de date online și va aplica acțiuni de cenzură. Dacă doriți să contestați o acțiune de cenzură AI, va trebui să vorbiți cu mașina. Poate că platformele vor angaja oameni pentru a răspunde apelurilor. Dar de ce ar face asta, când au AI care poate automatiza acele răspunsuri?

Fără protecție pentru tineri: Una dintre afirmațiile făcute de cenzorii guvernamentali este că trebuie să ne protejăm copiii de informațiile online dăunătoare, cum ar fi conținutul care îi face anorexici, îi încurajează să se sinucidă, îi transformă în teroriști ISIS și așa mai departe. Tot din exploatare sexuală. Toate acestea sunt probleme serioase care merită atenție. Dar ele nu sunt nici pe departe la fel de periculoase pentru un număr mare de tineri precum este cenzura AI.

Pericolul reprezentat de cenzura AI se aplică tuturor tinerilor care petrec mult timp online, deoarece înseamnă că activitățile lor online și limbajul pot fi monitorizate și folosite împotriva lor - poate nu acum, dar ori de câte ori guvernul decide să meargă după un anumit tip. de limbaj sau comportament. Acesta este un pericol mult mai mare pentru un număr mult mai mare de copii decât pericolul reprezentat de orice conținut specific, deoarece cuprinde toată activitatea pe care o desfășoară online, atingând aproape fiecare aspect al vieții lor.

Iată un exemplu pentru a ilustra acest pericol: Să presupunem că adolescentul tău joacă o mulțime de jocuri video interactive online. Să presupunem că se întâmplă să favorizeze jocurile concepute de companii chineze. Poate că îi urmărește și pe alții jucând acele jocuri și participă la discuții și grupuri de discuții despre acele jocuri, la care participă și mulți cetățeni chinezi.

Guvernul poate decide luna viitoare, sau anul viitor, că oricine este foarte implicat în jocuri video proiectate în China este un pericol pentru democrație. Acest lucru ar putea duce la închiderea conturilor de rețele sociale ale fiului tău sau la interzicerea accesului la instrumente financiare, cum ar fi împrumuturile pentru facultate. Ar putea implica, de asemenea, semnalarea lui pe site-urile de angajare sau întâlniri ca fiind periculos sau nedorit. Ar putea însemna că i se refuză pașaportul sau i se înscrie pe o listă de urmărire.

Viața adolescentului tău a devenit mult mai dificilă. Mult mai dificil decât dacă ar fi expus la un videoclip de recrutare ISIS sau la o postare TikTok care glorifica sinuciderea. Și asta s-ar întâmpla la o scară mult mai mare decât exploatarea sexuală pe care o folosesc cenzorii ca un cal troian pentru normalizarea ideii de cenzură guvernamentală online.

Servicii de cenzură care pot fi monetizate: Un instrument AI deținut de guvern poate fi, teoretic, utilizat de o entitate neguvernamentală cu permisiunea guvernului și cu binecuvântarea platformelor care doresc să „exteriorizeze” „responsabilitatea” pentru cenzură. Deci, în timp ce guvernul ar putea folosi AI pentru a monitoriza și a suprima, să spunem ca exemplu, sentimentul anti-război – o companie l-ar putea folosi pentru a monitoriza și a suprima, să spunem ca exemplu, sentimentul anti-fast-food. Guvernul ar putea câștiga mulți bani vânzând serviciile instrumentelor AI către terți. De asemenea, platformele ar putea cere o tăiere. Astfel, instrumentele de cenzură AI pot aduce beneficii guvernului, platformelor tehnologice și corporațiilor private. Stimulentele sunt atât de puternice, încât este aproape imposibil să ne imaginăm că nu vor fi exploatate.

Putem inversa cursul?

Nu știu câte agenții guvernamentale și câte platforme folosesc instrumente de cenzură AI. Nu știu cât de repede se pot extinde.

Nu știu ce instrumente avem la dispoziție – în afară de creșterea gradului de conștientizare și încercarea de a face lobby politicieni și de a intenta procese pentru a preveni cenzura guvernamentală și pentru a reglementa utilizarea instrumentelor AI pe internet.

Dacă cineva are alte idei, acum ar fi momentul să le implementeze.

Publicat sub a Licență internațională Creative Commons Attribution 4.0

Pentru retipăriri, vă rugăm să setați linkul canonic înapoi la original Institutul Brownstone Articol și autor.